Clay добавляет отслеживание жестов к ARKit без дополнительного оборудования

Одна из удивительных особенностей новой платформы ARKit заключается в том, что не требуется дополнительного оборудования.

Все удивительные впечатления от AR мы можем получить через камеру iPhone.

Теперь Clay хочет сделать то же самое с отслеживанием жестов.

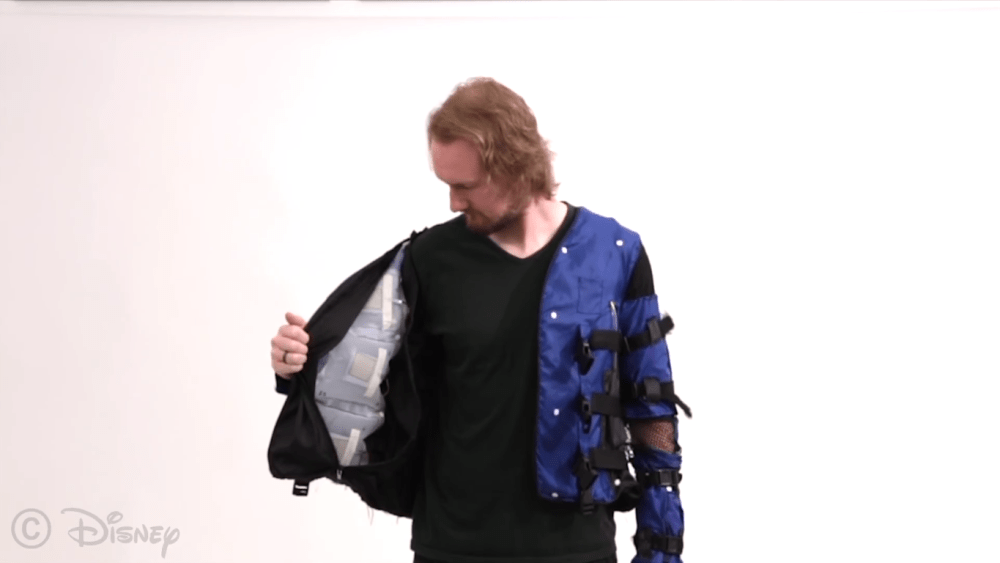

Разработчики уже знакомы с Clay, это SDK, который позволяет приложениям смартфонов отслеживать руку пользователя в 3D с помощью только камеры телефона. Он может распознавать более 30 ручных жестов, что позволяет без проблем контролировать навигацию. В прошлом компания продемонстрировала это, как способ взаимодействия с компьютерами и управления VR опытом на базе смартфонов. Вы можете увидеть примеры ниже.

https://youtu.be/Nqdsk4_COdU

После того, как Apple представила ARKit в прошлом месяце, команда Clay приступила к интеграции функциональности в SDK. Это означает, что ARKit может получить простые и доступные параметры управления, когда полностью запустится с iOS 11.

В настоящее время вы можете увидеть аналогичное решение с Microsoft HoloLens, где пользователи щелкают пальцами для взаимодействия с виртуальными объектами и интерфейсами в реальном мире. Другое дело, что iPhone не является AR гарнитурой (по крайней мере, пока), поэтому вам, вероятно, придется держать телефон одной рукой, а управлять другой.

SDK уже работает с движком Unity, поддержка телефонов Samsung Galaxy запланирована на ближайшее будущее.

Это звучит многообещающе, хотя нам еще только предстоит освоить новую платформу.

-

Подписывайся на Telegram

-

метки