Apple представляет новые API-интерфейсы в RealityKit 2 для улучшения AR-опыта

Вчера компания Apple представила новые инструменты и технологии, призванные помочь разработчикам создавать более привлекательные приложения и упросить этот процесс с помощью Xcode Cloud, улучшений в App Store, обновления языка программирования Swift, новых API в RealityKit 2.

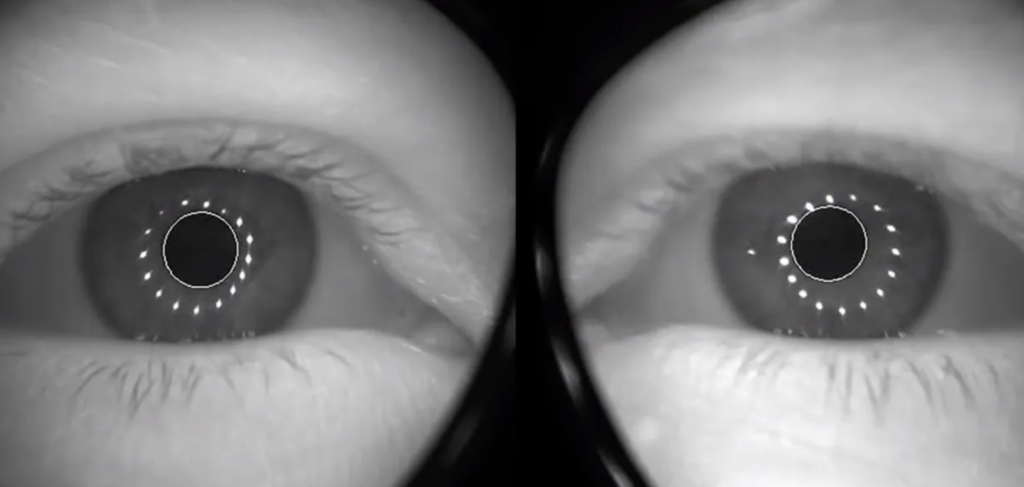

Платформа дополненной реальности ARKit от Apple поддерживает более 1 миллиарда устройств с поддержкой AR и позволяет разработчикам проектировать AR-опыт в сочетании с RealityKit. В сегодняшнем анонсе компания заявила, что RealityKit 2 представляет Object Capture, API на macOS Monterey, позволяющий создавать высококачественные фотореалистичные 3D-модели объектов реального мира за считанные минуты, используя фотографии, снятые на Iphone или Ipad. Они преобразуются в 3D-модели, оптимизированные для дополненной реальности.

Их можно просматривать в Quick Look или добавлять в AR-сцены в Reality Composer или Xcode, что значительно упрощает создание такого контента.

Представители Apple добавили, что с помощью новых API разработчики также смогут проектировать более реалистичные и сложные AR-интерфейсы с большим визуальным, звуковым и анимационным контролем, включая сложный рендеринг и динамические шейдеры.

Сьюзан Прескотт, вице-президент Apple по связям с разработчиками по всему миру, прокомментировала: «Это огромный шаг вперед в создании 3D-контента. То, что раньше было самой сложной и дорогой частью создания AR-опыта и 3D-сцен, теперь доступно всем в macOS Monterey.»

Для получения полной информации о сегодняшних анонсах посетите раздел новостей на официальном сайте компании.

-

Подписывайся на Telegram

-

метки